DeepSeek o ChatGPT: ¿qué herramienta de IA protege mejor tus datos?

Los modelos de lenguaje de gran tamaño (LLM por sus siglas en inglés) se han convertido en una parte más de la vida diaria de millones de personas. Herramientas como ChatGPT o DeepSeek gestionan todo tipo de tareas, desde preguntas sencillas hasta investigaciones empresariales y flujos de trabajo internos.

Sin embargo, al compartir información con un chatbot de IA, ¿sabes qué ocurre con los datos?

Hemos revisado a fondo las política de privacidad y los términos de uso de ChatGPT y DeepSeek para saber cómo recopilan, almacenan y usan los datos de los usuarios y lo que ello supone para su privacidad y seguridad en el mundo real.

Por qué son importantes la seguridad y la privacidad al elegir una IA

La privacidad de los datos es un aspecto clave al elegir una herramienta de IA porque los datos (inputs) que introduce el usuario se pueden registrar, retener o utilizar para entrenar a la IA y garantizar la calidad bajo ciertas condiciones. Las consultas o solicitudes (prompts) se procesan en la infraestructura del proveedor, fuera del control directo del usuario, y están sujetas a la política de gestión de datos de la plataforma.

Sin embargo, el riesgo aumenta al utilizarse la IA en los flujos de trabajo diarios. La gente usa los chatbots de IA tanto en contextos personales (por ejemplo, para pedir consejos sobre presupuestos) como en profesionales o médicos (documentación interna, revisión del código, planificación estratégica, etc.). Estos datos son confidenciales y probablemente no querrías que las compañías de IA los usaran para entrenar a sus modelos.

Al comparar los chatbots de IA, valorar la seguridad y la privacidad es tan importante como la calidad o la velocidad de las respuestas. Las prácticas y gestiones de datos exactas varían de un proveedor a otro y según el plan y la configuración del usuario. Dichas prácticas determinan si las consultas se almacenan, se revisan o se usan para mejorar los modelos. Estas son algunas de las preguntas que deberías hacerte:

- ¿Quién puede acceder a mis datos?

- ¿En qué condiciones se pueden reutilizar?

- ¿Cuánto puedo ver de lo que ocurre al enviar una consulta?

Cómo gestionan los datos del usuario DeepSeek y ChatGPT

Al interactuar con ChatGPT o DeepSeek, tus datos pasan por varias fases tras enviarlos. La forma en que cada plataforma gestiona los datos la determinan la política de privacidad y los términos de uso.

En términos prácticos, la gestión de los datos abarca tres aspectos:

- Cómo se procesan y registran las solicitudes.

- Si los datos que introduce el usuario se pueden usar para algo más que dar una respuesta inmediata.

- Cuánto tiempo permanecen los datos en el sistema del proveedor.

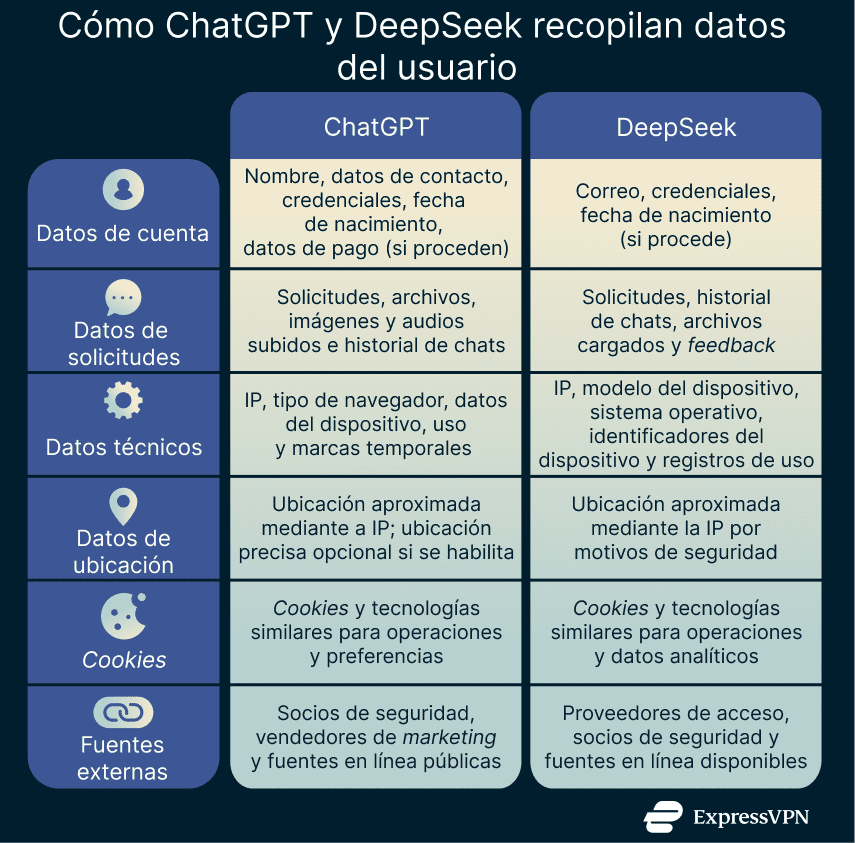

Recopilación de datos y registro de solicitudes

Tanto ChatGPT como DeepSeek recopilan datos de los usuarios como parte de la operación de sus servicios. Hablamos de los datos que aporta el usuario, la información generada a través de las interacciones con la plataforma y los datos técnicos recopilados automáticamente en segundo plano.

DeepSeek

DeepSeek recopila datos personales al crear una cuenta, enviar solicitudes, cargar archivos o interactuar con el servicio de cualquier otra forma. Entre estos datos, se encuentran el correo electrónico, el nombre de usuario y la contraseña, así como el contenido de las conversaciones, como las solicitudes, el historial de chats, el feedback y el material subido.

También recoge información del dispositivo y de la red, como la dirección IP, los identificadores del dispositivo, el sistema operativo, el idioma del sistema, los registros de rendimiento y los informes de errores. DeepSeek asigna identificadores (ID) al dispositivo y al usuario para rastrear la actividad durante la sesión y los dispositivos por motivos operativos y de seguridad. Asimismo, la compañía registra la forma en que los usuarios interactúan con las funciones, almacena la ubicación aproximada según la IP por cuestiones de seguridad y utiliza las cookies y otras tecnologías similares para operar y analizar su servicio.

En la política de privacidad también se indica que la compañía podría recibir datos personales de terceros, como los proveedores de acceso, socios de seguridad y fuentes en línea públicas. DeepSeek asegura que su servicio no está diseñado para procesar datos personales confidenciales y avisa de manera explícita a los usuarios de que no envíen tal información.

ChatGPT

ChatGPT recopila datos personales al crear una cuenta, enviar solicitudes, cargar contenido o comunicarse con OpenAI. Se incluye información de la cuenta, como el nombre, los datos de contacto, las credenciales y la información de pago si existe. El contenido del usuario incluye las solicitudes y los archivos, las imágenes y el audio subidos, según las funciones que se utilicen.

OpenAI también asegura en su política de privacidad que recopila datos técnicos generados a través del uso de su servicio, como la dirección IP, el tipo de navegador, las marcas de tiempo, los registros de interacción, los patrones de uso, la información del dispositivo y la ubicación general estimada a partir de la IP. Estos puntos de datos sirven de apoyo a la funcionalidad del servicio, al control de la seguridad y a la optimización del rendimiento. Las cookies y otras tecnologías similares se utilizan para mantener las preferencias y mejorar la experiencia del usuario.

A su vez, OpenAI recibe datos de socios de confianza, como los proveedores de seguridad y los vendedores de productos de marketing. Además, asegura que recopila información disponible de forma pública en Internet para desarrollar los modelos que impulsan sus servicios.

Uso de los datos de los usuarios para entrenar a los modelos

Las solicitudes de los usuarios no solo generan respuestas; en algunas implementaciones, también podrían recopilarse y analizarse para lograr mejoras futuras en los modelos.

DeepSeek

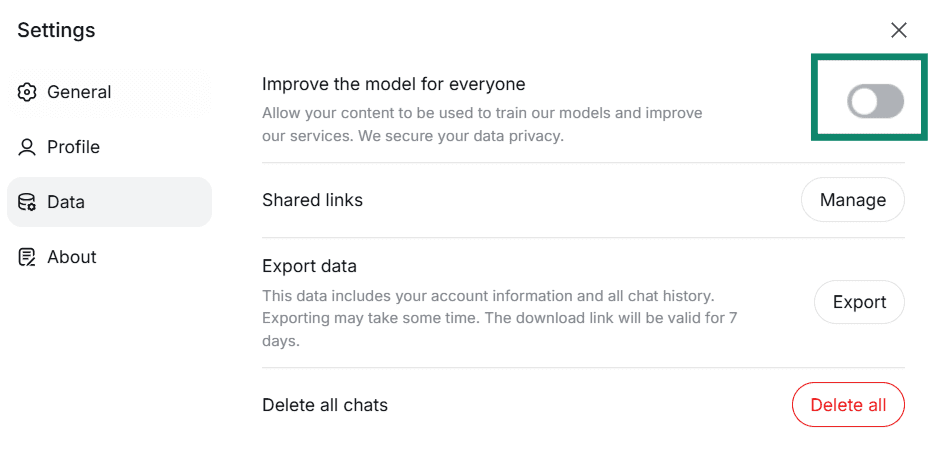

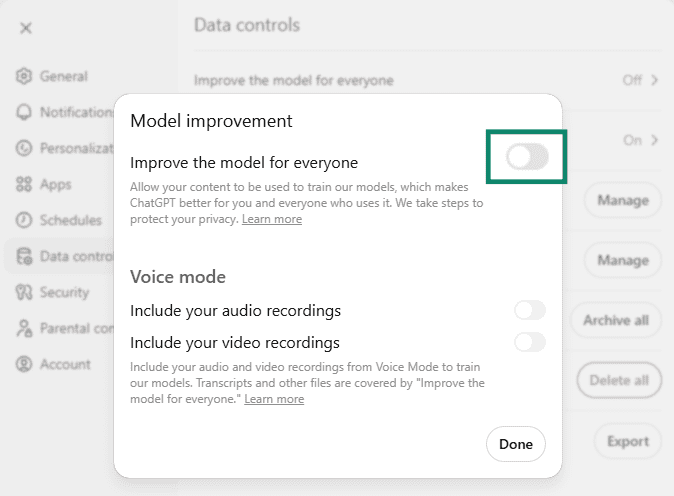

DeepSeek procesa los datos del usuario para operar y mejorar sus servicios como, por ejemplo, mediante el desarrollo de sus modelos. Al igual que ocurre con ChatGPT, puedes optar por no compartir tu contenido con fines de entrenamiento desde el apartado Settings (Configuración). Allí, solo tendrías que desactivar la opción Improve the model for everyone (Mejorar el modelo para todos) dentro de la sección Data (Controles de datos).

ChatGPT

ChatGPT podría aplicar un análisis automático y una revisión humana para mantener la calidad y la seguridad. Sin embargo, puedes cambiar los controles predeterminados de los datos entrando en Settings (Configuración) > Data Controls (Controles de datos) y desactivando Improve the model for everyone (Mejorar el modelo para todos). De esta forma, se impide que ChatGPT utilice tus datos para entrenar a sus modelos. Si dicha opción está desactivada, las próximas solicitudes se excluyen de los flujos de trabajo dedicados al entrenamiento, aunque los datos recopilados anteriormente podrían mantenerse. Asimismo, se podría acceder al contenido de los chats con otros fines, como investigar un incidente de seguridad.

Retención de datos y controles de eliminación

DeepSeek y ChatGPT retienen datos personales con fines operativos, legales y de seguridad, pero el ámbito y los controles difieren en la práctica.

DeepSeek

DeepSeek mantiene información personal tanto tiempo como le sea necesario para proporcionar sus servicios y cumplir las obligaciones legales, empresariales y contractuales. Por lo general, retiene información de la cuenta, la entrada de datos del usuario y los datos de pago mientras la cuenta esté activa. Si el usuario incumple las políticas de la plataforma, DeepSeek puede guardar los datos relevantes incluso tras cerrar su cuenta para investigar o abordar dicho incumplimiento.

Puedes borrar el historial de chats desde la configuración de tu cuenta, aunque DeepSeek no menciona en su política de privacidad cuánto tiempo tardaría en eliminar los datos de sus servidores. También puedes enviar una solicitud a privacy@deepseek.com para pedir la eliminación de tus datos. Puede que cierta información se mantenga en los casos necesarios por motivos legales o de cumplimiento.

ChatGPT

ChatGPT, al igual que DeepSeek, mantiene los datos personales tanto como sea necesario para operar sus servicios o con fines empresariales legítimos, ya sean de seguridad, de resolución de conflictos o de cumplimiento normativo. La duración de la retención de datos depende de factores como el propósito del procesamiento, la confidencialidad de los datos, el posible riesgo de accesos no autorizados y las obligaciones legales pertinentes.

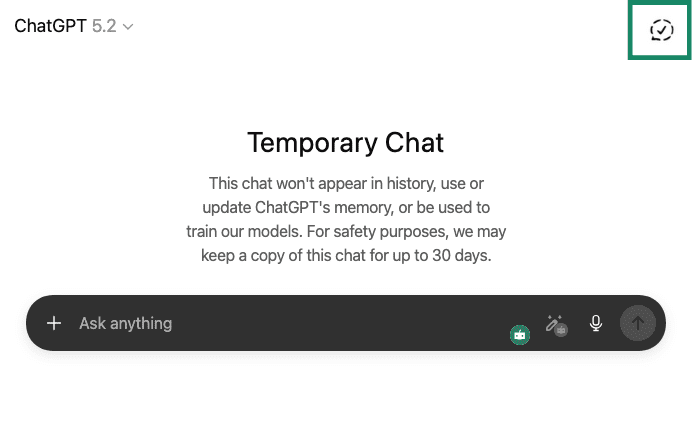

La configuración del usuario puede influir en la retención en ciertos casos. Por ejemplo, los chats temporales no aparecen en el historial de chats, pero se almacenan en los servidores de ChatGPT hasta 30 días. Lo mismo ocurre con los chats estándar que hayas eliminado del historial de chats.

Gestión de datos a través del portal de privacidad de ChatGPT

Puedes acceder al portal de privacidad de ChatGPT desde privacy.openai.com. Ahí puedes enviar las solicitudes formales relacionadas con tus datos personales, incluidas las peticiones de eliminación, acceso y corrección, así como otros derechos de privacidad. Además, no se trata simplemente de borrar el historial de chats, como permiten los controles de la aplicación, sino que el consumidor puede enviar solicitudes de privacidad directamente a OpenAI.

En el portal de privacidad puedes:

- Eliminar tu cuenta y los datos personales asociados: enviar la solicitud «eliminar mi cuenta de ChatGPT» supone la eliminación permanente de tu cuenta y prepara el borrado de tus datos de los sistemas de OpenAI, que suele ocurrir en unos 30 días.

- Solicitar acceso o una corrección: los usuarios con los derechos legales pertinentes (por ejemplo bajo el Reglamento general de protección de datos (RGPD) en Europa) pueden solicitar el acceso o la corrección de sus datos personales.

- Solicitar la eliminación de datos personales de las respuestas de ChatGPT: si una respuesta de ChatGPT incluye datos personales identificativos sobre ti (como tu nombre junto con datos confidenciales o privados), puedes enviar una solicitud de eliminación. OpenAI revisa la solicitud y, de aprobarla, daría los pasos necesarios para evitar que esos datos personales se generasen en futuras respuestas. Cabe mencionar que esta opción existe como una medida de protección de la privacidad y no significa que ChatGPT mantenga perfiles personales o recuerde a usuarios concretos a través de las conversaciones.

En definitiva, el portal de privacidad es el mecanismo formal para ejercer los derechos sobre tus datos cuando la configuración de la aplicación no sea suficiente.

IA de código abierto vs. IA comercial: la prioridad de la privacidad en la práctica

Los sistemas de IA difieren en su diseño, implementación y gobierno. Una de las distinciones más importantes radica entre los modelos de código abierto —donde partes del sistema son accesibles de manera pública— y los servicios de IA comerciales, en los que un solo proveedor controla de forma central el modelo y la infraestructura.

Qué supone el código abierto en la seguridad de DeepSeek

En el contexto de las IA, el código abierto implica que el código esté accesible para todo el mundo. De esta forma, se puede inspeccionar independientemente por cuestiones de seguridad o para detectar comportamientos no deseados en el propio código, sobre todo en las implementaciones autoadministradas.

El modelo R1 de DeepSeek está disponible en GitHub mediante una licencia del MIT. Dicha licencia permite el uso gratuito y sin restricciones del modelo, así como su modificación y distribución a cualquiera, incluso con fines comerciales.

Desde un punto de vista de seguridad y privacidad, la licencia tiene varias implicaciones:

- El modelo se puede autoadministrar, manteniendo así las solicitudes y las respuestas completamente en una infraestructura local o privada.

- Los investigadores independientes pueden hacer pruebas de seguridad para detectar vulnerabilidades.

- Las organizaciones pueden aplicar sus propios controles de acceso, registros y medidas de cumplimiento normativo.

A su vez, que sea de código abierto no significa que la transparencia sea total en toda la línea del desarrollo. De hecho, en el caso de muchos sistemas de IA etiquetados como «de código abierto», tanto el origen como la composición y el procesamiento previo del corpus de entrenamiento no son públicos, aunque el código del modelo lo sea. Esto restringe la verificación independiente de los datos de entrenamiento del modelo y puede influir en las evaluaciones de privacidad, sesgo y confianza.

DeepSeek no muestra públicamente los conjuntos de datos de entrenamiento al completo, lo cual se ajusta a la restricción mencionada y supone que la transparencia a nivel de código no se extiende automáticamente a los datos de entrenamiento ni a los procesos de desarrollo.

Infraestructura centralizada y confianza en ChatGPT

ChatGPT opera en una infraestructura que controla OpenAI. Los usuarios interactúan con el modelo a través de interfaces web o API y todas las solicitudes se procesan dentro de los sistemas gestionados por OpenAI.

En este modelo:

- OpenAI controla dónde y cómo se procesan los datos.

- Los usuarios dependen de las políticas documentadas en lugar de una inspección directa del código.

- Los controles de seguridad, las restricciones de acceso y la supervisión se aplican de manera central.

Puesto que el modelo y la infraestructura subyacentes son de su propiedad, ningún agente externo puede auditar el sistema al completo de manera independiente. Aunque esto limita la transparencia, permite a OpenAI estandarizar los controles de seguridad y aplicarlos de forma consistente para todos los usuarios.

Cabe destacar que OpenAI ha superado evaluaciones controladas y revisiones de cumplimiento normativo, entre las que se incluyen auditorías internas y valoraciones externas asociadas a requisitos legales y de seguridad.

Medidas de seguridad técnicas: cifrado y control de acceso

ChatGPT y DeepSeek utilizan una combinación de cifrado y controles de acceso para proteger los datos de los usuarios en sus plataformas. Estas medidas de protección están diseñadas para reducir el riesgo de accesos externos no autorizados, en lugar de para ofrecer una confidencialidad de extremo a extremo desde el propio proveedor de servicios.

Cifrado en tránsito y en reposo

Ambas plataformas de IA aplican un cifrado para proteger los datos de los usuarios mientras se transmiten y cuando están almacenados en sus sistemas.

ChatGPT cifra los datos en reposo mediante un cifrado de nivel estándar en la industria, como es Advanced Encryption Standard (AES) de 256 bits. Todos los puntos de conexión hacen uso del protocolo Transport Layer Security (TLS) 1.2 (o superior) para cifrar los datos enviados entre los usuarios, OpenAI y los proveedores de servicios de OpenAI, lo cual ayuda a proteger la información ante posibles interceptaciones durante el tránsito en la red. La seguridad física de su infraestructura la gestiona Microsoft Azure.

DeepSeek cifra la comunicación entre los usuarios y sus servidores web mediante HTTPS (TLS), lo cual garantiza que los datos en tránsito queden protegidos ante interceptaciones pasivas.

Controles de acceso y protección a nivel de cuenta

Los controles de acceso determinan quién puede acceder a los datos de los usuarios dentro de la plataforma y bajo qué condiciones. En la documentación oficial de DeepSeek se informa de que el acceso a los servicios y a las bases de datos está restringido solo a personal autorizado mediante medidas de autenticación y control de acceso.

OpenAI implementa medidas de control de acceso estrictas según los principios de privilegios mínimos y separación de funciones. El acceso se concede solo cuando es necesario por motivos operativos, de seguridad o legales y está sujeto a una revisión habitual.

Asimismo, OpenAI asegura que supervisa y registra los accesos de manera continua. Los registros se recopilan y revisan de forma centralizada para detectar actividad inusual. Además, los permisos de acceso se auditan y revocan periódicamente si ya no son necesarios. Por otro lado, los sistemas internos y administrativos requieren una autenticación multifactor (MFA) y los cambios en los accesos internos se documenta y revisan.

Limitaciones del cifrado en los chatbots de IA

Los chatbots de IA no utilizan cifrado de extremo a extremo. De hecho, para generar las respuestas, servicios como ChatGPT y DeepSeek necesitan desencriptar y procesar las solicitudes en sus propios servidores.

Por lo tanto, cualquier dato que introduzcas se puede usar internamente según las reglas de la plataforma, ya sea para, por ejemplo, operar el servicio, comprobar la seguridad, revisar la calidad o mejorar el modelo, según cual sea tu configuración. Es decir, aunque el cifrado protege tus datos en tránsito y en reposo, no evita que el proveedor acceda a ellos.

En definitiva, el cifrado y los controles de acceso deberían considerarse medidas de seguridad importantes, pero no una garantía de privacidad total. Por eso, lo mejor es suponer que todo lo que se comparte con un chatbot de IA se puede almacenar o revisar según las políticas del proveedor.

Casos de uso empresarial y alojamiento

Las empresas que integran la IA en sus flujos de trabajo o que proporcionan con ella acceso a información propia mediante API deben tener en cuenta el aislamiento de los datos, el control de acceso, el cumplimiento normativo y la responsabilidad operativa. Todo ello varía en función de si la herramienta de IA se entrega como un servicio alojado o implementado en una infraestructura interna.

ChatGPT Enterprise: controles de aislamiento, privacidad y gobernanza

ChatGPT Enterprise está diseñado para las organizaciones que quieran usar un servicio de IA alojado, al mismo tiempo que aplican una gobernanza y unos controles de privacidad más potentes que los disponibles en las cuentas de los consumidores.

OpenAI no utiliza contenido enviado a través de ChatGPT Enterprise para entrenar a sus modelos. Las conversaciones se aíslan a nivel de organización y el acceso está gobernado mediante controles administrativos en lugar de la configuración de usuarios individuales. De esta forma, las organizaciones pueden gestionar cómo se usa la IA internamente sin depender de empleados que configuren las opciones de privacidad por sí mismos.

Desde el punto de vista de la gobernanza, las organizaciones pueden controlar el acceso de los usuarios, gestionar las políticas de uso y monitorizar la actividad de los diversos equipos. Esto respalda los requisitos de cumplimiento normativo internos y las auditorías. Aunque OpenAI sigue manejando la infraestructura de forma central, estos controles permiten a las empresas con límites más definidos gestionar los datos dentro del servicio. Esto resulta aún más importante cuando se utiliza ChatGPT como una herramienta de IA para desarrolladores o como una herramienta de de IA de inteligencia empresarial, donde las solicitudes pueden incluir código propio, API internas, diseños de sistema o datos analíticos confidenciales.

Por otro lado, ChatGPT Enterprise no cambia el modelo de implementación alojado. Los datos se siguen procesando en la infraestructura gestionada que gestiona OpenAI y las organizaciones siguen dependiendo de las prácticas de seguridad de OpenAI y de los controles de acceso internos. La diferencia radica en cómo se gobiernan y aíslan los datos a nivel de organización, en lugar de dónde o cómo se opera la infraestructura.

DeepSeek autoalojado: ventajas y responsabilidades

DeepSeek se puede autoalojar en la infraestructura interna de una organización, como en servidores «on-premises» o en entornos de nube privados. De esta forma, se puede reducir la latencia en ciertos entornos y se consigue más control sobre la privacidad, la retención de datos y una configuración personalizada. Las solicitudes y las respuestas no salen de la red de la organización, lo cual simplifica la gobernanza de los datos y reduce la exposición a infraestructuras externas.

En el caso de las organizaciones en sectores regulados como el financiero, el sanitario o el gubernamental, el autoalojamiento les permite usar sus medidas de seguridad actuales, procesos de auditoría y reglas de almacenamiento de datos directamente con el sistema de IA. El acceso se puede restringir mediante sistemas de identidad internos y el uso se puede controlar con las mismas herramientas de supervisión y registro que ya estén implementadas para otras cargas de trabajo confidenciales.

Sin embargo, el autoalojamiento deriva la responsabilidad a la organización. En este caso, la empresa se convierte en la responsable de proteger el entorno, gestionar los controles de acceso, supervisar el uso, gestionar las actualizaciones y garantizar el cumplimiento normativo de las leyes pertinentes y de las políticas internas. También podría necesitar muchos recursos computacionales para operar y refinar el modelo. Además, a diferencia de los modelos basados en API (gestionados por el proveedor), necesitarías experiencia y conocimientos para implementar y mantener el sistema.

Dicho de otra forma, la privacidad y la seguridad dependen de lo bien que la organización diseñe y opere su entorno, no de los controles predeterminados de la plataforma.

Cómo usar la IA de forma más segura

ChatGPT, DeepSeek y otros chatbots de IA son sistemas de procesamiento de datos. Todo lo que introduzcas, ya sea por escrito o por voz, se almacena y registra y puede revisarse y retenerse con fines operativos. Lo mismo ocurre con los archivos que subas. Esta situación crea riesgos reales de filtración de datos, sobre todo cuando las solicitudes incluyen datos personales o información sobre la empresa o bien cuando el contexto se puede utilizar con otros fines si se tiene acceso a esos datos en otro momento.

Las mejores prácticas para evitar compartir información confidencial

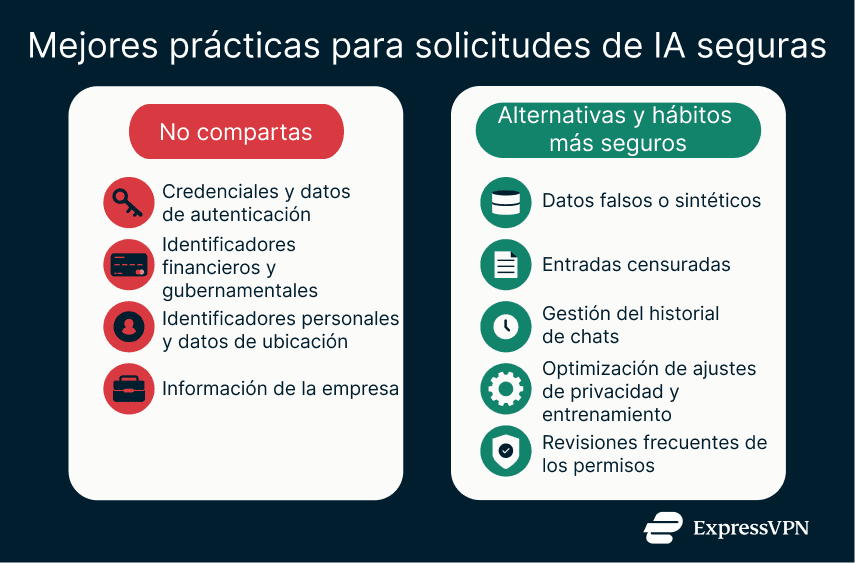

No veas ChatGPT o DeepSeek como un amigo o confidente. Si tienes información que no compartirías con extraños, no lo hagas tampoco con un chatbot de IA.

- No compartas identificadores directos ni credenciales: jamás escribas contraseñas, códigos de autenticación, el número de la tarjeta de crédito, datos bancarios o números de identificación expedidos por el gobierno.

- Cuida los datos personales y de ubicación: el nombre completo junto con la dirección, el número de teléfono o los datos del correo electrónico podrían filtrar más datos de los que quisieras, sobre todo si las solicitudes tienen un contexto personal.

- Trata siempre la información sobre la empresa como confidencial: los documentos internos, los contratos, los datos financieros, las listas de consumidores y el código fuente no se deberían compartir en solicitudes a menos que la herramienta esté aprobada explícitamente para ese uso.

- Utiliza entradas de datos censuradas o sintéticas siempre que puedas: cuando necesites ayuda con una situación real, sustituye los datos reales por datos que parezcan realistas pero que sean falsos. Los ejemplos sintéticos te permiten obtener respuestas útiles sin compartir información real. Si censuras o modificas datos clave como el nombre de usuario, el nombre de cuenta o el nombre de un sistema interno, reduces de manera significativa el riesgo sin que la solicitud sea menos efectiva.

- Gestiona la configuración de retención de datos y entrenamiento: muchas herramientas de IA ofrecen opciones para borrar el historial de chats o no participar en la recopilación de solicitudes para entrenar a los modelos de IA. Estos ajustes no siempre están activos de manera predeterminada. Por eso, revisarlos y modificarlos te ayuda a limitar la retención de datos a largo plazo y a reducir las posibilidades de que las solicitudes confidenciales se reutilicen de forma interna.

- Revisa los permisos y los hábitos de uso con frecuencia: las herramientas de IA evolucionan rápidamente, al igual que sus opciones de configuración. Por eso, revisa las opciones de privacidad cada cierto tiempo, así como las aplicaciones conectadas y los permisos de navegación, para garantizar que el acceso siga alineado con el uso que quieras hacer de la herramienta. Este control de la situación es aún más importante en entornos con equipos de trabajo o dispositivos compartidos.

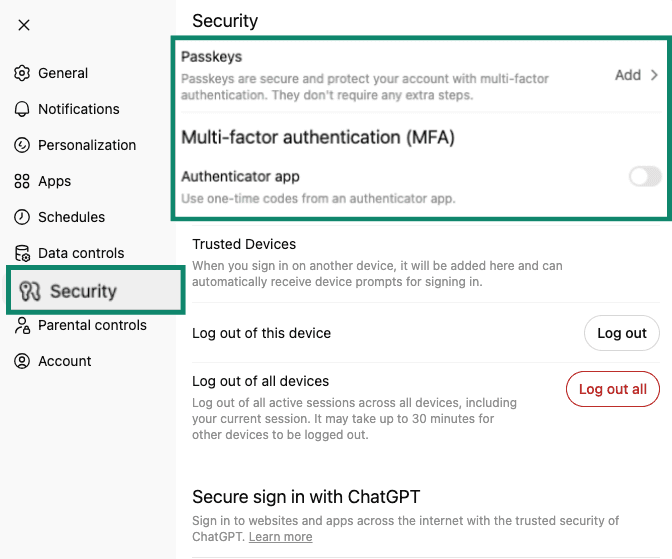

- Protege tu cuenta con una contraseña segura: tu historial de chats y el uso están asociados a tu cuenta, por eso, si tu contraseña quedara expuesta, podrían filtrarse tus conversaciones anteriores y, quizá, una gran cantidad de datos confidenciales. Utiliza una contraseña única y larga para proteger tu cuenta. Si utilizas ChatGPT, habilita la autenticación multifactor (MFA) con una aplicación autenticadora o con claves de paso (passkeys) para impedir los accesos no autorizados. En el momento de escribir este artículo, DeepSeek no tiene estas opciones. Nota: Tanto la MFA como las claves de paso no están disponibles para todos los usuarios de ChatGPT. Para ver si estas funciones están disponibles en tu caso y, por lo tanto, habilitarlas, accede a Settings (Configuración) > Security (Seguridad).

Cómo puede una VPN mejorar tu privacidad al usar una IA

Utilizar una red privada virtual o Virtual Private Network (VPN) con ChatGPT aumenta la seguridad a nivel de red durante tus sesiones con la IA. Las VPN cifran la conexión a Internet del usuario, lo cual evita que agentes externos, como los operadores de red o un atacante dentro de la misma red wifi, intercepten tu actividad. Además, sustituye tu IP por la del servidor VPN, por lo que se reduce el seguimiento pasivo a nivel de conexión. Esta opción es muy útil al acceder a herramientas de IA desde redes públicas o poco seguras.

Aun así, es importante saber los límites. Al iniciar sesión para usar el servicio, tu actividad se asocia a tu cuenta, utilices una VPN o no. Las VPN no ocultan las solicitudes ante el proveedor de la IP ni evitan que la plataforma procese o almacene los datos introducidos. Sin embargo, lo que sí hace es protegerte ante una posible interceptación de datos fuera del servicio de IA, lo cual es muy útil si trabajas en remoto o viajas.

En los entornos de empresas, las VPN suelen utilizarse junto a implementaciones de IA empresariales o modelos autoalojados para ofrecer una protección por capas. A diferencia de las VPN comerciales, cuyo diseño está pensado para anonimizar el tráfico de Internet de los consumidores, las VPN empresariales forman parte del propio perímetro de red de la organización, habilitando el enrutamiento interno, el acceso por identidad y el cumplimiento de la política centralizada. Esta configuración reduce la exposición al limitar el lugar donde fluye el tráfico de la IA y al mantener las solicitudes confidenciales dentro de redes controladas.

Preguntas frecuentes sobre DeepSeek y ChatGPT

¿ChatGPT entrena sus modelos con las conversaciones de los usuarios?

En las versiones Gratis, Plus y Pro de ChatGPT, las conversaciones de los usuarios se pueden usar para mejorar los modelos, según la configuración de la cuenta. Los usuarios pueden excluirse de este uso desde los controles de privacidad. ChatGPT no utiliza las conversaciones de las cuentas empresariales y corporativas para entrenar a sus modelos.

¿Pueden ambas herramientas utilizarse para datos regulados o confidenciales?

ChatGPT Enterprise ofrece garantías de gobernanza y gestión de datos para el uso empresarial, mientras que DeepSeek se puede autoalojar, por lo cual los datos se mantienen en los sistemas internos. En entornos regulados, las organizaciones suelen necesitar políticas claras, modelos de implementación aprobados y controles internos antes de usar herramientas de IA con datos confidenciales.

¿Es seguro usar una VPN con chatbots de IA?

Utilizar una VPN con chatbots de IA es seguro y no interfiere en el funcionamiento de estas herramientas. Las VPN afectan a la conexión de red al cifrar el tráfico y ocultar la dirección IP del usuario, pero no cambia la forma en que el proveedor de IA procesa, almacena o accede a las solicitudes. De hecho, debería verse como una medida de privacidad complementaria y no como un control sobre el propio chatbot.

Da el primer paso para protegerte en Internet. Prueba ExpressVPN sin riesgos.

Obtén ExpressVPN